您的位置:上海毫米网络优化公司 > 网站优化分享 >

相关推荐recommended

- SpringBoot项目中各层的关系和作用

- 分布式系统架构中的相关概念

- IntelliJ IDEA 2023.3 的 AI Assistant

- 代码插入数据库数据时报错:Cause: com.mysql.cj.jd

- CC++数据结构之链表题目答案与解析

- Windows 安装 Apache 和 PHP的详细步骤

- 数学建模--评价类模型

- Nginx 日志配置

- 【Spring】SpringBoot整合MybatisPlusGern

- 已解决com.mysql.cj.jdbc.exceptions.Com

- 基于在线学习的分布式流量实时分析系统设计与实现

- springboot 查看和修改内置 tomcat 版本

- Springboot图书馆座位预约管理系统设计与实现 计算机专业毕业设

- 【Review+预测】测试架构演进的曲折之路

- Prometheus实战篇:Prometheus监控nginx

- 大数据 DataX-Web 详细安装教程

- 详解实现黑马旅游网的ES和Mysql数据同步

- Django学习(1):Django项目的初步创建与简单配置

- mongodb 安装

- Loading class `com.mysql.jdbc.Drive

- 前端实现调用打印机和小票打印(TSPL )功能

- .Net4.0 Web.config 配置实践

- vanna:基于RAG的text2sql框架

- 华为ensp中nat server 公网访问内网服务器

- 实验一 关系数据库标准语言SQL 课后习题头歌

- 【postgresql 基础入门】数据类型介绍,整型,字符串,浮点数,

- Python 操作 json 数据

- mysql 事务详解一

- Flink实战之 MySQL CDC

- 【docker挂载问题】( OCI runtime create fa

SpringBoot集成flink

作者:mmseoamin日期:2024-04-27

Flink是一个批处理和流处理结合的统一计算框架,其核心是一个提供了数据分发以及并行化计算的流数据处理引擎。

最大亮点是流处理,最适合的应用场景是低时延的数据处理。

场景:高并发pipeline处理数据,时延毫秒级,且兼具可靠性。

环境搭建:

①、安装flink

https://nightlies.apache.org/flink/flink-docs-master/zh/docs/try-flink/local_installation/

②、安装Netcat

Netcat(又称为NC)是一个计算机网络工具,它可以在两台计算机之间建立 TCP/IP 或 UDP 连接。

用于测试网络中的端口,发送文件等操作。

进行网络调试和探测,也可以进行加密连接和远程管理等高级网络操作

yum install -y nc # 安装nc命令 nc -lk 8888 # 启动socket端口

无界流之读取socket文本流

一、依赖

springboot-demo com.et 1.0-SNAPSHOT 4.0.0 flink 8 8 org.springframework.boot spring-boot-starter-web org.springframework.boot spring-boot-autoconfigure org.springframework.boot spring-boot-starter-test test org.apache.flink flink-streaming-java 1.17.0 org.apache.flink flink-java 1.17.0 org.apache.flink flink-clients 1.17.0 org.apache.flink flink-connector-base 1.17.0 org.apache.flink flink-connector-files 1.17.0 org.apache.flink flink-connector-kafka 1.17.0 org.apache.flink flink-runtime-web 1.17.0 org.apache.maven.plugins maven-shade-plugin package shade META-INF/spring.handlers META-INF/spring.factories META-INF/spring.schemas com.et.flink.job.SocketJob

二、SoketJob

public class SocketJob{

public static void main(String[] args)throws Exception{

// 创建执行环境

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

// 指定并行度,默认电脑线程数

env.setParallelism(3);

// 读取数据socket文本流 指定监听 IP 端口 只有在接收到数据才会执行任务

DataStreamSource socketDS = env.socketTextStream("172.24.4.193", 8888);

// 处理数据: 切换、转换、分组、聚合 得到统计结果

SingleOutputStreamOperator> sum = socketDS

.flatMap(

(String value, Collector> out) -> {

String[] words = value.split(" ");

for (String word : words) {

out.collect(Tuple2.of(word, 1));

}

}

)

.setParallelism(2)

// // 显式地提供类型信息:对于flatMap传入Lambda表达式,系统只能推断出返回的是Tuple2类型,而无法得到Tuple2。只有显式设置系统当前返回类型,才能正确解析出完整数据

.returns(new TypeHint>() {

})

// .returns(Types.TUPLE(Types.STRING,Types.INT))

.keyBy(value -> value.f0)

.sum(1);

// 输出

sum.print();

// 执行

env.execute();

}

}

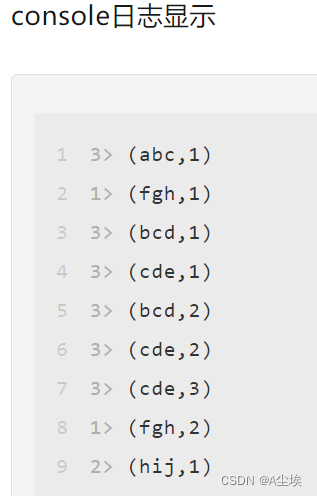

测试:

启动socket流:

nc -l 8888

本地执行:直接ideal启动main程序,在socket流中输入

abc bcd cde bcd cde fgh cde fgh hij

集群执行:

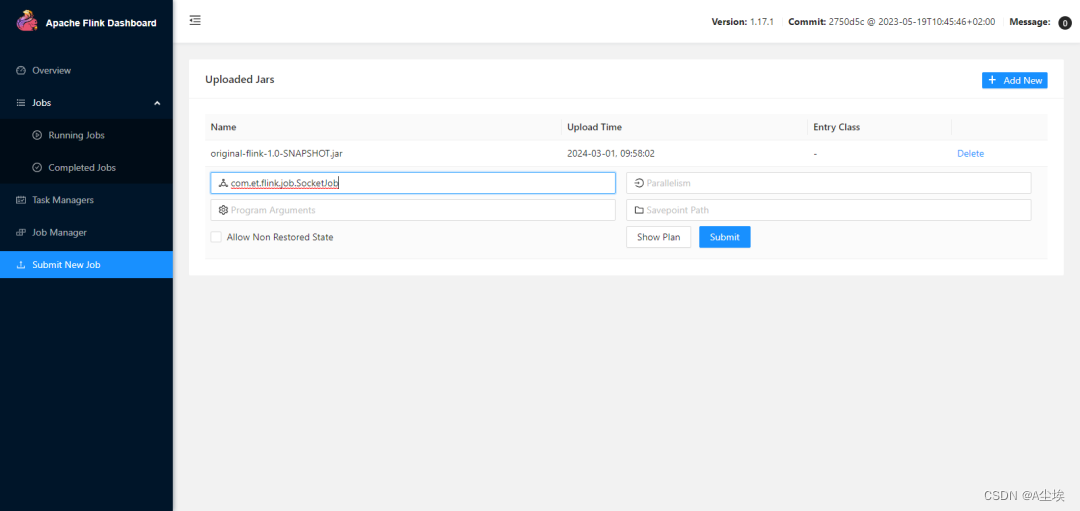

执行maven打包,将打包的jar上传到集群中