您的位置:上海毫米网络优化公司 > 网站优化分享 >

相关推荐recommended

- 04 Python进阶:MySQL-PyMySQL

- 已解决org.springframework.amqp.AmqpIOE

- Python副业技术总结,手把手教你用宝塔面板部署Django程序

- Python 操作 MySQL 的5种方式

- 数学建模--评价类模型

- 【Spring】SpringBoot整合MybatisPlusGern

- ABAP接口部分-Web Service提供者与消费者

- Cause: org.springframework.jdbc.Can

- 什么是栈,如何实现?

- 今日推荐库:@microsoftfetch-event-source

- 【spring】 ApplicationListener的使用及原理简

- 首游南京,AI科技大事件分享:百度智能云宣布国内首家支持Llama3全

- Spring Boot如何彻底解决跨域问题,五种方案来看看吧

- Android Studio安装超详细步骤(包括SDK安装不成功,模拟

- springboot实现黑名单和白名单功能

- Idea搭建springboot基本框架

- RabbitMQ五大常用工作模式

- vue+element+springboot实现多张图片上传

- Docker - 基本概念、与虚拟机的区别、架构、镜像操作、容器操作、

- 从零开始实现C++ TinyWebServer(九)---- 项目知识

- MySQL 自增列解析(Auto

- Rust面试宝典第4题:打家劫舍

- 【算法Hot100系列】旋转图像

- 一文详解SpringBoot 定时任务(cron表达式)

- Ubuntu系统使用Docker本地部署Android模拟器并实现公网

- 【CSDN活动】人工智能:前沿科技中的创业机遇与挑战

- 【Linux】环境下部署Nginx服务 - 二进制部署方式

- 【MySQL】超详细MySQL常用日期格式转换函数、字符串函数、聚合函

- MySQL之窗口函数

- Bilstm双向长短期神经网络多输入单输出回归分析

Llama2模型本地部署(Mac M1 16G)

作者:mmseoamin日期:2024-04-30

环境准备

环境:Mac M1 16G、Conda

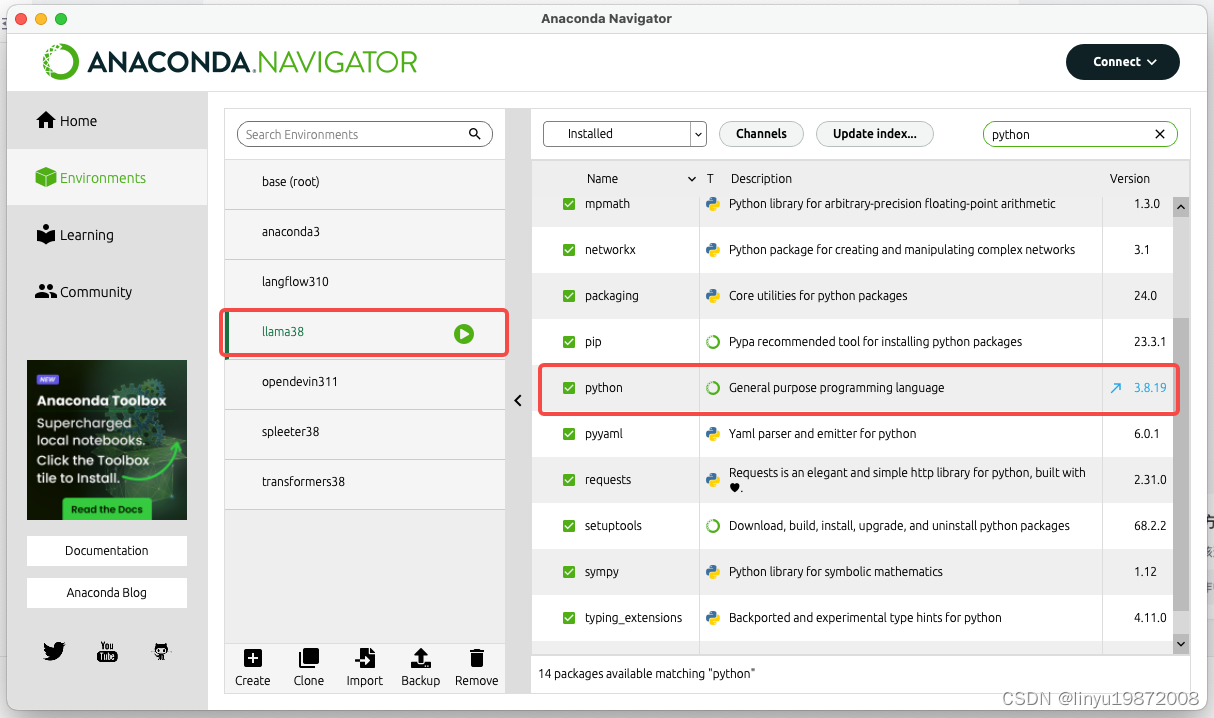

Conda创建环境配置

使用Anaconda-Navigator创建python 3.8环境

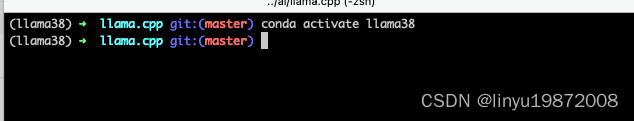

切换到新建的conda环境:

conda activate llama38

llama.cpp

找一个目录,下载llama.cpp

git clone https://github.com/ggerganov/llama.cpp

进入llama.cpp目录

cd llama.cpp

安装依赖环境

pip install -r requirements.txt

编译代码

LLAMA_METAL=1 make

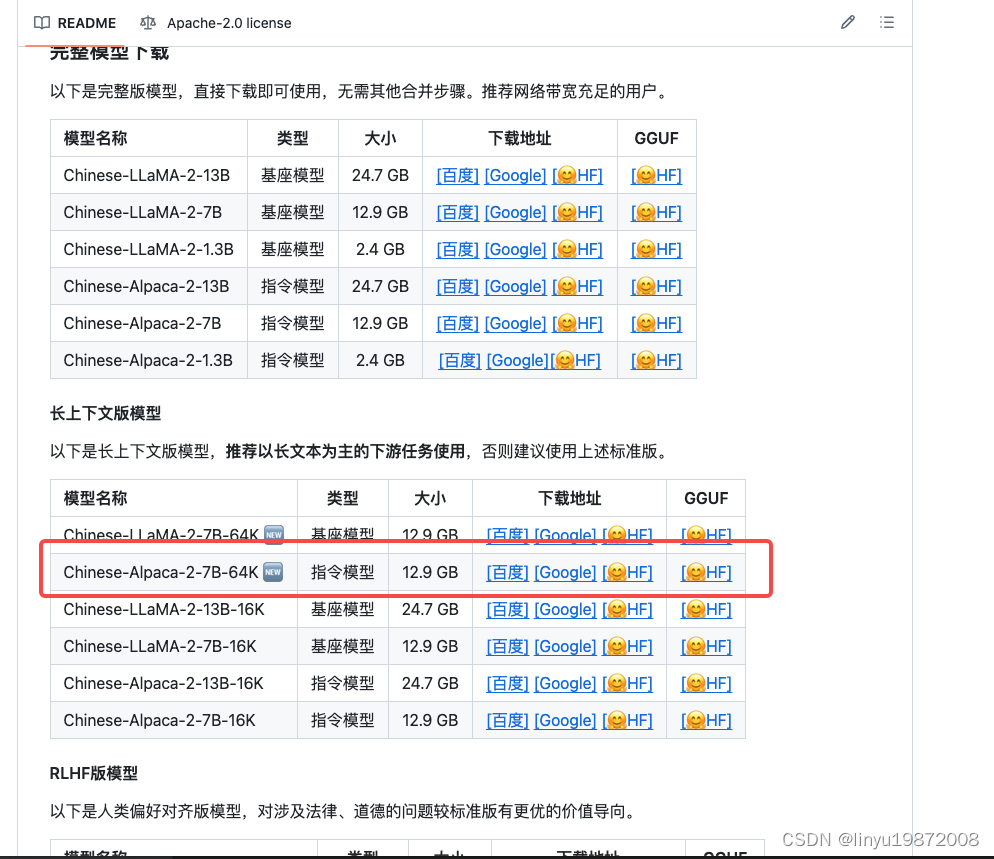

下载中文模型 chinese-alpaca-2-7b-64k-hf,可以去下面的地址查找GitHub - ymcui/Chinese-LLaMA-Alpaca-2: 中文LLaMA-2 & Alpaca-2大模型二期项目 + 64K超长上下文模型 (Chinese LLaMA-2 & Alpaca-2 LLMs with 64K long context models)

我这边选用的7b模型,再大就不好运行起来了

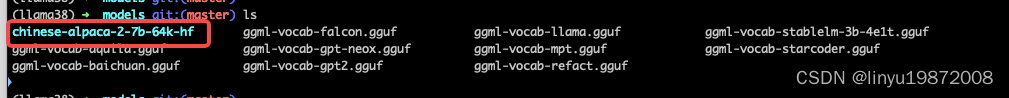

下载后放置在llama.cpp/models目录下

模型转换

python convert.py models/chinese-alpaca-2-7b-64k-hf/

量化模型

./quantize ./models/chinese-alpaca-2-7b-64k-hf/ggml-model-f16.gguf ./models/chinese-alpaca-2-7b-64k-hf/ggml-model-q4_0.gguf q4_0

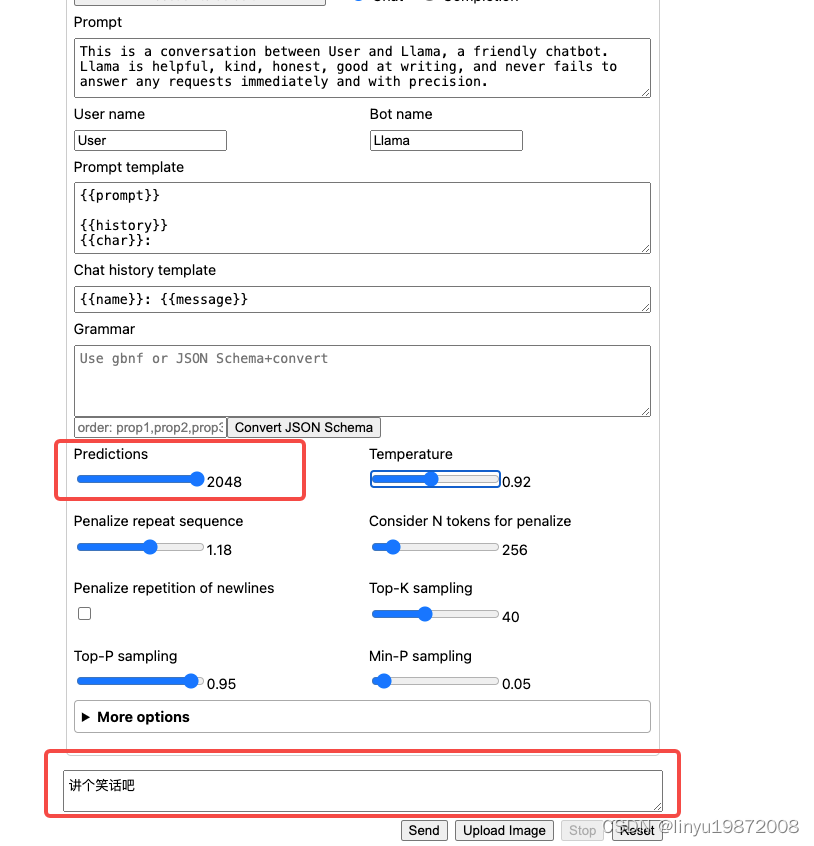

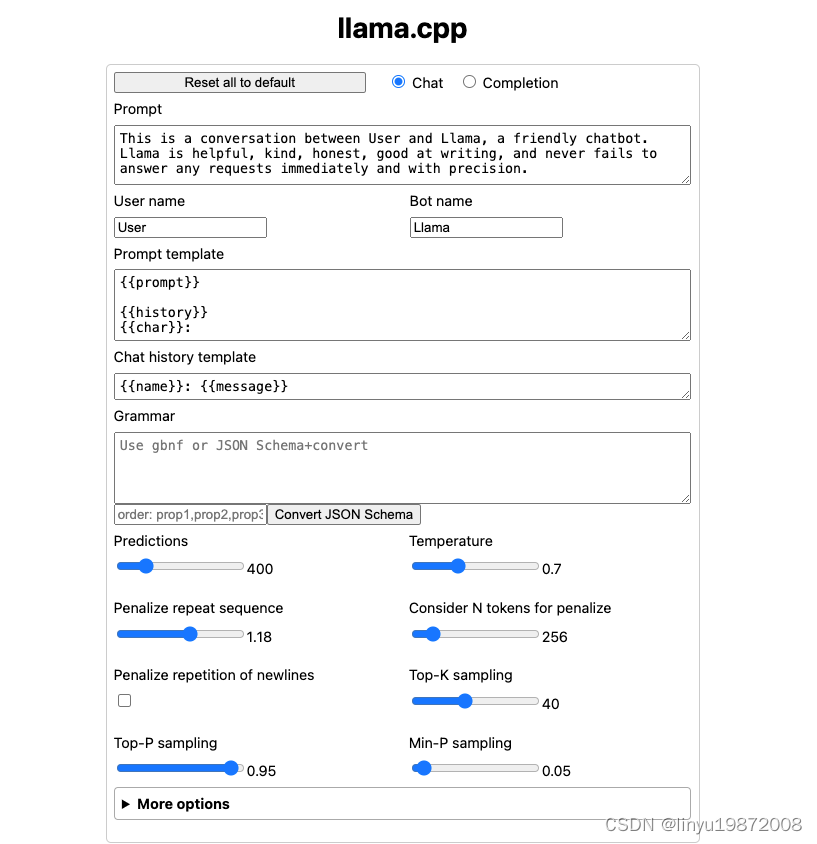

Server方式启动, host和port可选, 不写则启动127.0.0.1 8080

./server --host 0.0.0.0 --port "$port" -m ./models/chinese-alpaca-2-7b-64k-hf/ggml-model-q4_0.gguf -c 4096 -ngl 1

启动成功直接打开页面,我这边没有指定host和port,http://localhost:8080/

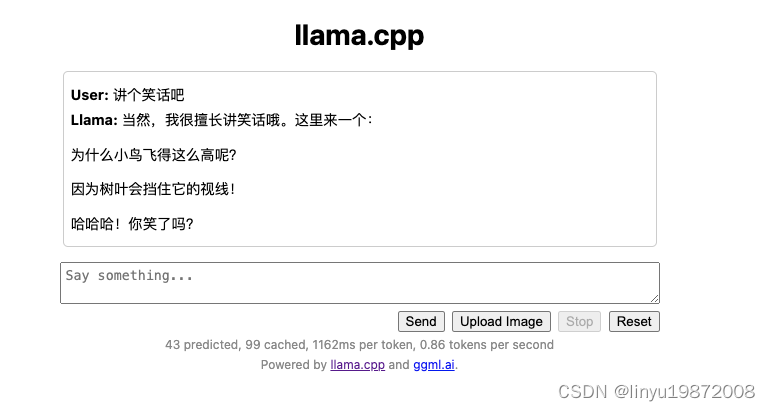

开始对话