您的位置:上海毫米网络优化公司 > 网站优化分享 >

相关推荐recommended

- Java社区疫情防控系统设计与实现(Idea+Springboot+m

- 肝了半年,我整理出了这篇云计算学习路线(新手必备,从入门到精通)

- Rust面试宝典第6题:快乐数

- 云计算的大数据处理:实时分析与批处理

- 【面试高高手】—— SpringCloud(共22题)

- Springboot各版本与Java JDK的对应关系及JDK商用版本

- 「PHP系列」PHP $

- 逆向爬虫技术的进阶应用与实战技巧

- 【Linux实践室】Linux高级用户管理实战指南:创建与删除用户组操

- 达梦兼容MySQL问题

- 【LeetCode力扣】287.寻找重复数(中等)

- Spring Boot启动时执行初始化操作的几种方式

- 探索设计模式的魅力:开启智慧之旅,AI与机器学习驱动的微服务设计模式探

- Spring Boot中多线程的使用

- PostgreSQL的date

- MyBatis和MyBatis Plus并存及问题解决

- SpringBoot使用WebSocket

- Python某城市酒店爬虫数据可视化分析和推荐查询系统

- QT学习之路——Qt QMySQL driver not loaded

- MySQL的指令大全和注意事项(强烈推荐收藏)

- C语言——详解字符函数和字符串函数(二)

- Nginx:配置文件详解

- JavaWeb项目:航班信息管理系统(tomcat+jsp)

- webrtc视频播放器(ZLMRTCClient.js)

- 解决org.apache.tomcat.dbcp.dbcp.SQLNe

- Loading class `com.mysql.jdbc.Drive

- 基于在线学习的分布式流量实时分析系统设计与实现

- Jenkins简介及安装配置详解:开启持续集成之旅

- SpringBoot整合Druid数据库连接池&多数据源&am

- Rust 高性能的跨平台 GUI 框架

监督学习 - 逻辑回归(Logistic Regression)

作者:mmseoamin日期:2024-02-04

什么是机器学习

逻辑回归(Logistic Regression)虽然名字中包含"回归"一词,但实际上是一种用于解决分类问题的统计学习方法,而不是回归问题。它是一种线性模型,常用于二分类问题,也可以扩展到多分类问题。

基本原理

模型表示

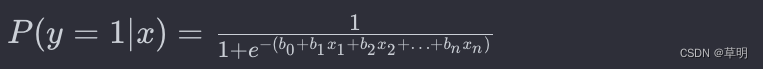

逻辑回归模型假设输入特征的线性组合,然后通过一个称为逻辑函数(也称为sigmoid函数)将结果映射到一个概率值。对于二分类问题,模型表示如下:

其中 b0,b1,b2,…,bn 是模型参数,x1,x2,…,xn 是输入特征。

决策边界

模型的输出值可以解释为样本属于类别1的概率,通常当输出概率大于等于0.5时,模型预测样本属于类别1;当输出概率小于0.5时,模型预测样本属于类别0。

训练

逻辑回归的训练过程涉及最大化似然函数(最大似然估计)或最小化对数损失函数。通常使用梯度下降等优化算法进行参数优化。

优点

- 简单而高效,特别适用于线性可分或近似可分的问题。

- 输出结果是概率形式,易于解释。

适用场景

- 二分类问题

- 多分类问题

- 线性决策边界足够解决问题的情况

代码示例(使用Python和 scikit-learn):

from sklearn.linear_model import LogisticRegression from sklearn.model_selection import train_test_split from sklearn.metrics import accuracy_score, classification_report # 假设X是特征矩阵,y是目标变量 X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # 创建逻辑回归模型 model = LogisticRegression() # 训练模型 model.fit(X_train, y_train) # 预测 y_pred = model.predict(X_test) # 评估模型性能 accuracy = accuracy_score(y_test, y_pred) report = classification_report(y_test, y_pred) print(f'Accuracy: {accuracy}') print(f'Classification Report:\n{report}')上述示例演示了使用 scikit-learn 库中的逻辑回归实现的基本步骤。在实际应用中,需要根据具体问题进行特征工程、调参等处理。